7月7日,欧盟发布了三份GMP文件征求意见稿,分别是《第四章:文件记录》(Chapter 4: Documentation),《附录11:计算机化系统》(Annex 11: Computerised System),和《附录22:人工智能》(Annex 22: Artificial Intelligence),征求意见均截至10月7日。

三份指南紧密关联,欧盟从GMP最核心的文件记录模块出发,囊括传统计算机化系统和最前沿的人工智能(AI)技术考量,预期将为制药行业带来深远变革。

《第四章:文件记录》:监管理念革新

欧盟GMP第四章的原版还是早在2014年11月发布的《EU GMP 第一部分 - 药品的基本要求》中。

EU之所以发起修订GMP中的一个章节,其原因是GMP/GDP检查员工作组和PIC/S委员会共同建议修订,以反映监管和生产环境的变化。修订后的指南明确了监管机构对文件管理的要求和期望,并考虑了附录11的相关变化。

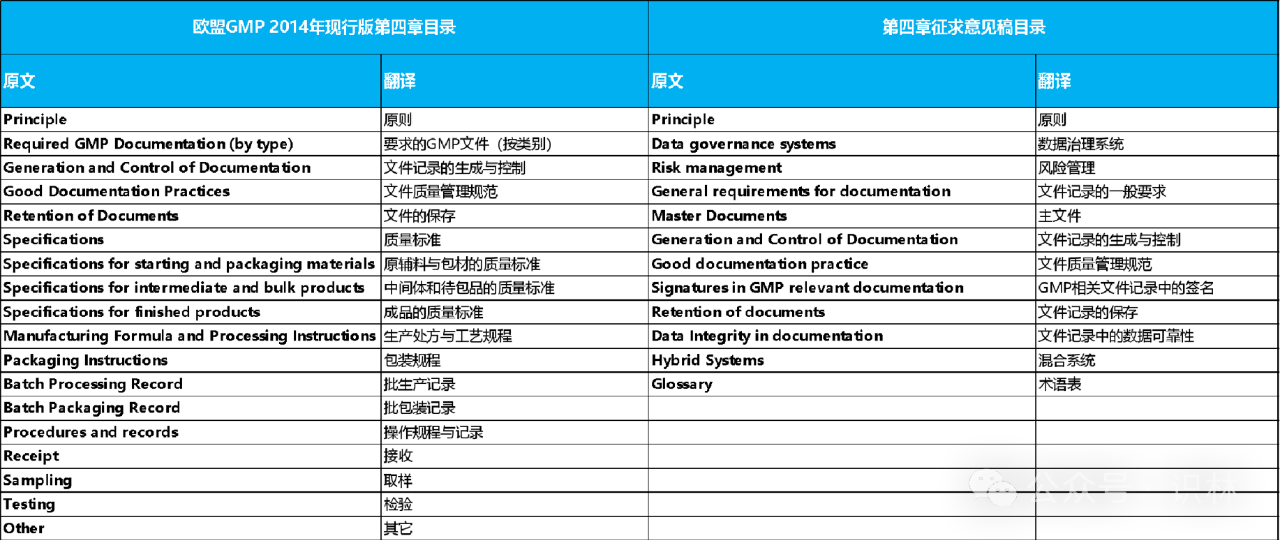

将两个版本的第四章目录简要对比:

仅从目录即可看出文件记录的GMP监管理念将迎来根本性变革,从“需要哪些文件记录”转变为“文件记录如何管理以及如何与新技术进行整合”,这其中就包括AI。新版第四章将“验证脚本”和附录22适用的AI作为自动化方法,纳入质量管理体系。

《附录11:计算机化系统》:适配新IT环境和云服务

附录11现行版是14年前的2011年6月发布版本,查阅花脸稿可以看到,其内容可谓推倒重来。

EMA曾于2022年11月发布修订附录11的概念性文件,其中就已提到旧指南无法指导新技术的问题。此次修订后的指南应明确监管机构的要求和期望,并特别强调新指南将消除歧义和不一致之处。

指南草案旨在应对不断变化的IT环境、云服务的广泛应用以及GMP活动所用计算机化系统中新技术的引入,提供更新的监管指导,并促进欧盟成员国与PIC/S之间的统一方法。该附录适用于药品和活性物质生产中使用的各种计算机化系统,其核心内容包括:

生命周期管理:计算机化系统在投入使用前必须经过验证,并在整个生命周期内保持验证状态。

质量风险管理(QRM):QRM应贯穿于GMP活动所用计算机化系统生命周期的所有阶段,考虑流程复杂性、自动化水平和创新性,以及对产品质量、患者安全和数据可靠性的影响。

替代做法:如果能够证明替代做法可提供相同或更高水平的控制并以文件记录,则可以使用并替代附录中要求的活动。

数据可靠性:GMP活动中使用的系统所采集、分析和报告的数据必须可信。数据可靠性遵循ALCOA+原则,涵盖数据处理、身份和访问管理、审计追踪、电子签名和安全性等方面的要求。

系统要求:系统要求描述受监管用户在执行GMP活动时依赖的自动化功能,其应被记录并保持更新,以完全反映已实施的系统及其预期用途。这些要求是系统确认和验证的基础。

外包活动:即使使用外包活动,受监管用户仍需对遵守附录中的要求、维护相关证据以及在监管审查中提供这些证据负全部责任。

安全性:受监管用户应及时了解针对GMP系统的新型安全威胁,并在必要时及时实施和改进保护措施。

不增加风险:当计算机化系统替代其他系统或手动操作时,不应降低产品质量、患者安全或数据可靠性,也不应增加整体过程风险。

《附录22:人工智能》:大语言模型“不应用于关键的GMP应用”

从标题可想而知,该附录是全新起草的,也将成为全球主要监管机构发布的第一份针对AI的GMP文件。

指南草案仅6页,但措辞明确,尤其是定义了哪些AI将受到严格监管。

指南草案适用于药品和活性物质生产中使用的各种计算机化系统,其中AI模型用于对患者安全、产品质量或数据可靠性有直接影响的关键应用,例如用于预测或分类数据。本附录针对嵌入了AI模型的计算机化系统,提供了对附录11的补充指导。

指南草案适用的模型包括:

通过数据训练获得功能的机器学习(AI/ML)模型,而不是通过明确编程实现功能的模型。这些模型可能由多个独立模型组成,每个模型使GMP中的特定工艺步骤自动化。

静态模型,即在使用过程中不通过纳入新数据来调整其性能的模型。动态模型(即在使用过程中持续自动学习并调整性能的模型)不在本附录的适用范围内,也不应用于关键的GMP应用(should not be used in critical GMP applications)。

具有确定性输出的模型,即在给定相同输入时提供相同输出的模型。因此,具有概率性输出的模型(即在给定相同输入时可能不提供相同输出的模型)不在本附录的适用范围内,也不应用于关键的GMP应用。

指南草案不适用于生成式AI(Generative AI)和大语言模型(LLM)——即当前最火热的ChatGPT和DeepSeek类产品——并明确指出这些模型不应用于关键的GMP应用。即使药企在非关键GMP应用中使用(即对患者安全、产品质量或数据可靠性没有直接影响),也要始终由具备适当资质和培训的人员负责确保这些模型的输出适合预期用途,即采用“人在回路”(Human-in-the-Loop, HITL)的方式,并在适用时考虑指南草案中描述的原则。

四川省医药保化品质量管理协会举办2026

当前,制药行业正处于合规升级与绿..关于举办四川省药品生产企业拟新任质量

各相关企业: 新修订的《中华人..四川省医药保化品质量管理协会党支部

2026年4月8日上午,省医药保化品质..四川省医药保化品质量管理协会党支部

2026年4月8日上午,省医药保化品质..关于收取2026年度会费的通知

各会员单位: 在过去的一年里,..四川省医药保化品质量管理协会党支部召

按照省市场监督管理局社会组织联合..